Jak przyspieszyć indeksowanie strony w Google?

Nawet najlepsze strategie marketingowe nie pozwolą uzyskać zadowalających efektów, jeśli strona nie będzie widoczne w wyszukiwarce Google z powodu zbyt wolnego lub nieprawidłowego indeksowania. Aby podstrony zostały zindeksowane potrzeba zwykle czasu, ale jeśli utrudnia to pracę i zaprezentowanie nowego contentu odbiorcom w odpowiednim czasie – warto wykonać poniższe czynności, aby przyspieszyć indeksowanie.

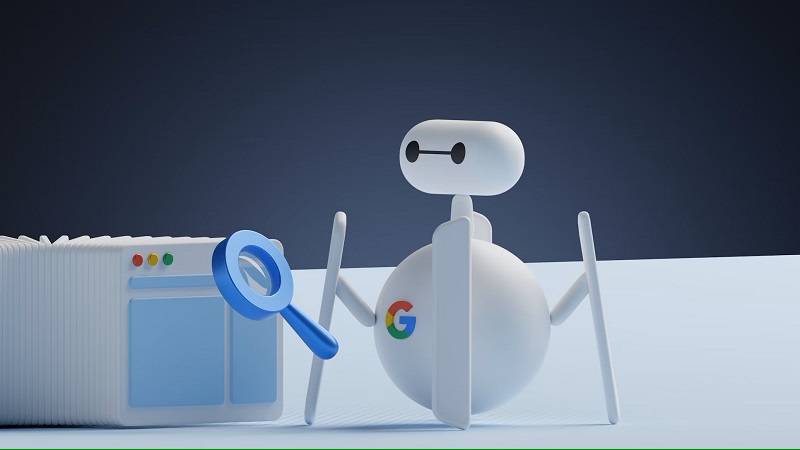

Jak działa indeksowanie strony w Google?

Indeksowanie strony w wyszukiwarce to dość złożony proces polegający na skanowaniu danej witryny przez roboty Google. Analizują one dokładnie strukturę oraz treść strony i szukają ważnych informacji, a także linków prowadzących do różnych podstron lub innych stron. Zgromadzone dane zostają przetworzone oraz zaindeksowane, czyli dodane do bazy danych Google. Roboty wyszukiwarki tworzą bazy biorąc pod uwagę potencjalne pytania użytkowników wpisywane w Google.

Ile zwykle trwa indeksowanie witryny w Google?

Niestety, nie można jednoznacznie odpowiedzieć na to pytanie, ponieważ czas indeksowania witryny jest zależny od kilku czynników, między innymi od:

- struktury oraz jakości kodu HTML – kiedy kod jest właściwie zoptymalizowany, proces skanowania odbywa się szybciej;

- liczby i jakości linków, które prowadzą do danej strony – wiarygodne linki mają pozytywny wpływ na prędkość indeksowania podstron;

- częstotliwość publikacji nowych treści – odświeżane strony są częściej odwiedzane przez roboty wyszukiwarki;

- szybkość ładowania strony – szybko działający serwer jest szybciej poddawany procesowi indeksacji;

- poprawnie działająca mapa strony – dzięki niej roboty szybciej mogą znaleźć i zindeksować wszystkie podstrony danej witryny.

Cały proces trwa zwykle od kilku dni, ale może przeciągnąć się do kilku tygodni. Szacuje się również, że nowy artykuł na blogu może potrzebować tygodnia. Warto zauważyć, że domeny z autorytetem są szybciej indeksowane – zwykle w ciągu 2-3 dni.

Jak przyspieszyć indeksowanie strony?

Istnieje kilka sposobów, które pozwalają przyspieszyć indeksowanie podstron witryny. Należą do nich między innymi następujące czynności:

- wysłanie prośby o zindeksowanie strony lub podstron w Google Search Console;

- dodanie mapy strony;

- poprawienie struktury linków wewnętrznych oraz profilu linków zewnętrznych.

Wysłanie prośby o zindeksowanie podstron przez Google Search Console

Wysłanie prośby o indeksację w GSC jest bardzo proste. Wystarczy zalogować się, a następnie wybrać URL inspection. Następnie należy wkleić adres URL i wysłać prośbę o indeksację. Po chwili pojawia się informacja, że wybrana podstrona zostanie szybciej sprawdzona przez roboty wyszukiwarki.

Dodanie mapy strony na serwer

Ten sposób także jest bardzo prosty. Najpierw należy utworzyć mapę, można to zrobić za pomocą różnych darmowych programów. Następnie wystarczy zalogować się do Google Search Console, wybrać sekcję Indexing i kliknąć na Sitemaps, a następnie wkleić adres mapy strony.

Poprawa struktury linków wewnętrznych i profilu linków zewnętrznych

Szybszemu indeksowaniu sprzyja przejrzysta struktura linkowania wewnętrznego. Takie linki powinny być więc rozmieszczone w logiczny sposób i powinny prowadzić do najistotniejszych miejsc witryny. Ułatwi to nie tylko szybszą indeksację robotom, ale i nawigację użytkownikom. Bardzo ważne są również linki zewnętrzne z tematycznych i autorytatywnych witryn. Aby sprawdzić, czy dana domena jest godna uwagi, można sprawdzić jej autorytet za pomocą różnych narzędzi m.in. takich jak Ahrefs. Z kolei profil linków witryny, zarówno tych wewnętrznych, jak i zewnętrznych, można sprawdzić w Google Search Console w sekcji Links.

Podsumowanie

Aby uzyskać zadowalający efekt nie wystarczy stworzyć stronę internetowej i zadbać o marketing czy prowadzenie social media. Istotne są także sprawy techniczne, takie jak indeksowanie strony w wyszukiwarce Google. Proces ten z różnych powodów może zostać opóźniony nawet o kilka tygodni, warto więc regularnie sprawdzać stan podstron i w razie potrzeby stosować powyższe sposoby, czyli wysłanie ręcznej prośby o indeksację w Google Serach Console, zadbanie o strukturę linków wewnętrznych i odnośników zewnętrznych czy utworzenie i dodanie do witryny mapy ułatwiającej robotom wyszukiwarki poruszanie się po jej obrębie. Dzięki tym czynnościom podstrony mogą zostać zaindeksowane już po 2-3 dniach.